As próximas eleições podem ser completamente diferentes das anteriores. Deepfakes e algoritmos de inteligência artificial podem manipular a imagem e o som de uma forma tão precisa que é muito difícil distinguir conteúdo falso de conteúdo real. E a menos que a lei regule claramente estes métodos de cibercriminalidade, as consequências podem ser realmente muito graves. Este problema é representado pela situação que aconteceu nos EUA – Kari Lake, candidata ao Senado, tentou ser vítima de um deepfake.

A inteligência artificial pode mudar o rumo das eleições – Índice

AI será o próximo jogador nas eleições

Deepfakes estão se tornando uma ameaça cada vez mais séria à integridade eleitoral – esta tecnologia pode influenciar o processo democrático através da manipulação de informações e da falsificação de conteúdos. O rápido desenvolvimento da inteligência artificial permite a criação de materiais cada vez mais convincentes, capazes de apresentar os políticos em situações que nunca aconteceram. O conteúdo gerado por IA é frequentemente distribuídos nas redes sociais, onde ganham enorme alcance e muitas pessoas nem sequer percebem que se trata de falsificações destinadas a manipular as suas preferências políticas.

A corrida tecnológica entre criadores de materiais falsificados e especialistas que tentam detectá-los revela que os cibercriminosos se adaptam rapidamente aos novos métodos de detecção tornando cada vez mais difícil distinguir os seus “produtos” do conteúdo real.

Talvez a pior notícia seja que não se trata mais apenas dos grandes atores do crime cibernético. Substancialmente qualquer pessoa com um pouco de habilidade é capaz de gerar um vídeo assim. Basta observar a escala de recursos da ferramenta SoraAI da OpenAI. A criação desse material nem requer um bom programa de edição de vídeo.

Várias instituições e organizações como a ESET (uma empresa internacional de segurança cibernética) enfatizam a necessidade de uma ação decisiva para proteger a democracia da manipulação da IA, salientando a necessidade de esforços conjuntos a nível legislativo, tecnológico e social para combater eficazmente a desinformação. No entanto, até que sejam tomadas medidas decisivas, veremos situações como o recente incidente do Lago Kari.

Deepfake de Kari Lake

A organização da Agenda do Arizona usou inteligência artificial e a imagem da candidata ao Senado Kari Lake, do Partido Republicano, para crie um filme falso com a participação dela. O vídeo mostrou como essa tecnologia poderia ser usada para manipular informações no contexto de eleições.

O vídeo, que inicialmente mostrava uma mulher fazendo declarações falsas e polêmicas, terminou um alerta sobre o potencial uso de inteligência artificial influenciar o eleitorado nas eleições. Resumindo – a tecnologia foi usada para alertar contra isso, assim como no último anúncio famoso da T-Mobile.

Kari Lake ordenou que a empresa removesse o vídeo de todos os canais disponíveis, mas milhares de americanos conseguiram assisti-lo. De acordo com O Washington Post há muitos indícios de que a IA e a ansiedade que a acompanha já estão a influenciar as eleições desta forma.

Como os deepfakes podem influenciar as eleições?

Vídeos ou gravações de áudio falsos podem ser usados para divulgar informações falsas sobre candidatos, enganando os eleitores e potencialmente influenciando suas decisões de voto. Um vídeo realista mostrando um candidato fazendo declarações controversas pode prejudicar sua reputação e chances eleitorais mesmo que o material seja posteriormente negado.

Mas esta não é a única ameaça associada a esta tecnologia. A aparência de tais materiais fabricados pode contribuir para um aumento geral do ceticismo e da confusão entre os eleitores quanto à autenticidade de todas as informações, mesmo aquelas provenientes de fontes confiáveis.

Deepfake na Polônia

Há muito conteúdo na Internet que mostra, por exemplo, o atual Presidente da Polônia, Andrzej Duda, em diversas situações engraçadas. Basta digitar a frase “Andrzej Duda deepfake” e perceberemos que poder reside na IA.

Vale lembrar também como, em agosto de 2023, a Plataforma Cívica utilizou inteligência artificial para criar a voz do primeiro-ministro Mateusz Morawiecki. O material não foi devidamente marcado como gerado por IA, o que causou grande polêmica.

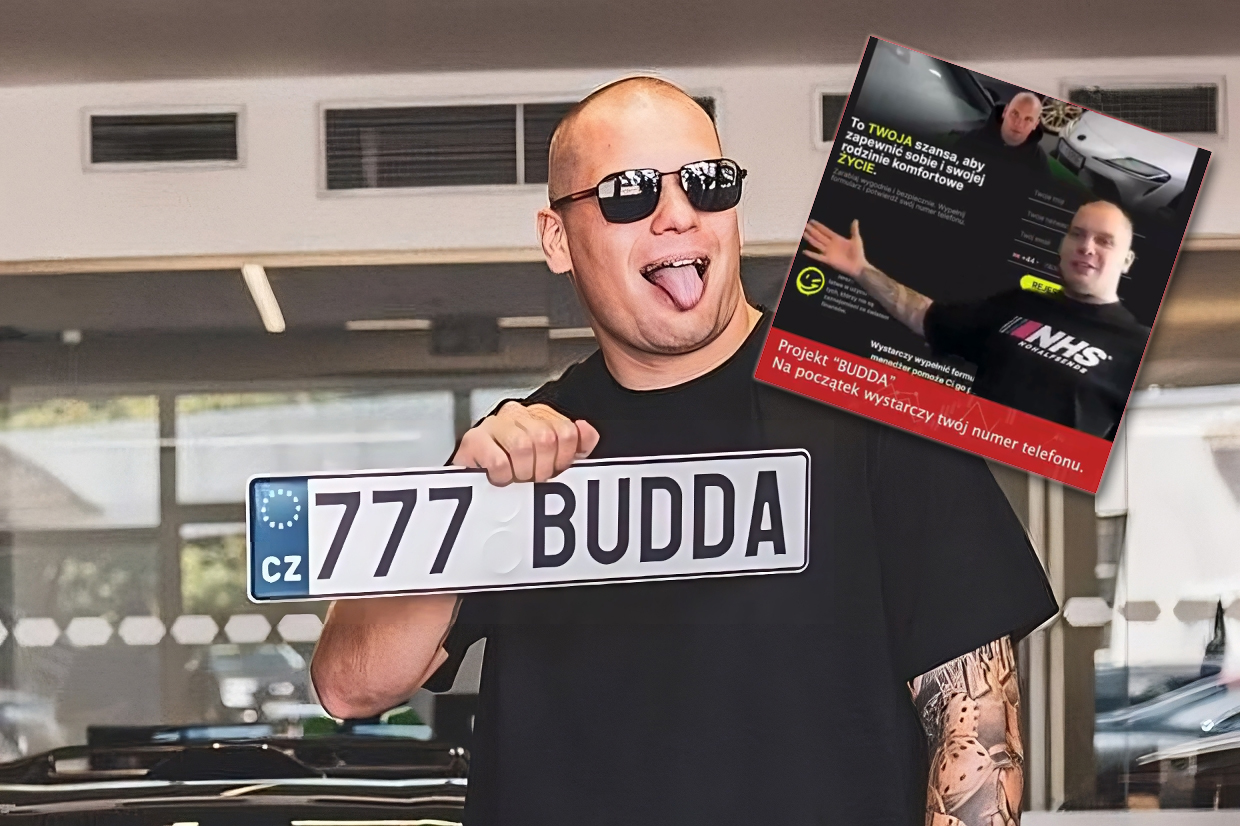

No final de fevereiro de 2024, um deepfake com Buda também apareceu na Internet. O golpe envolvendo um famoso YouTuber automotivo polonês consistia em: utilizar sua imagem em campanha de incentivo ao investimento garantindo um lucro de um milhão de zlotys. O vídeo do Buda promoveu um misterioso programa de negociação automatizado, que é um exemplo clássico de investimento falso projetado para extorquir dinheiro.

Fonte: O Washington Post, ed. ter. Foto de abertura: terovesalainen / Depositphotos

Alguns dos links são links afiliados ou links para ofertas de nossos parceiros. Após clicar, você poderá ver o preço e a disponibilidade do produto que selecionamos – você não incorre em nenhum custo e ao mesmo tempo apoia a independência da equipe editorial.